پیوندهای مرتبط

شرکت ها و تشکل های منتخب

جدال گوگل و واشنگتن بر سر حقیقتِ هوش مصنوعی

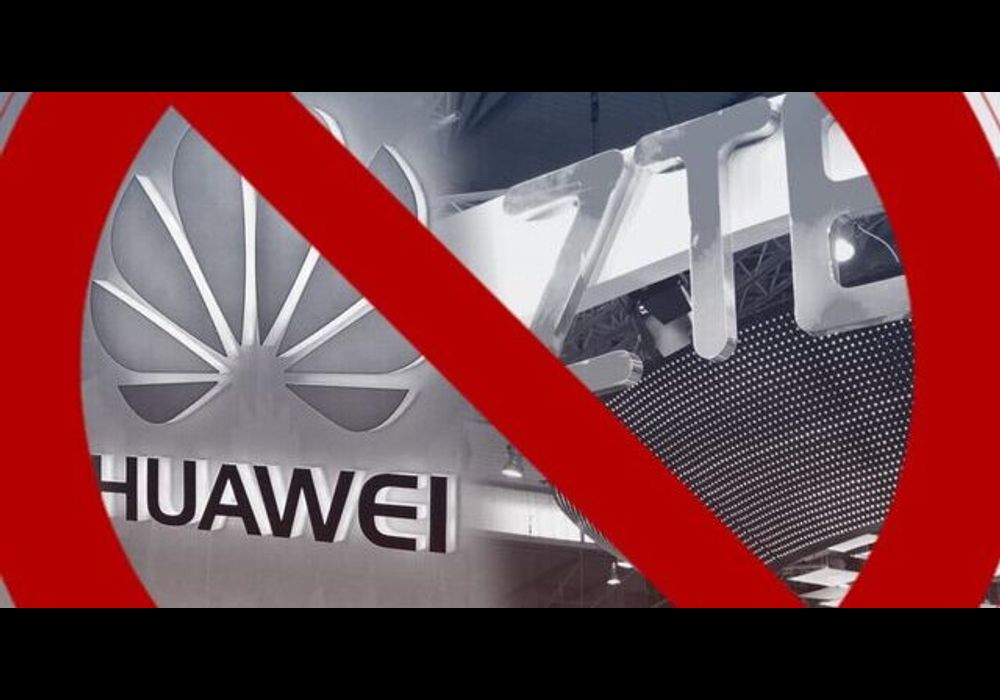

در میانهٔ نبردی که مرزِ فناوری و سیاست را در هم آمیخته، گوگل با ارسال نامهای رسمی به سناتور مارشا بلکبرن تلاش کرده است از مدلِ هوش مصنوعی خود دفاع کند؛ مدلی که بهدلیل «توهمهای دادهای» اش، اکنون در کانونِ اتهامِ جعل و سوگیری سیاسی قرار دارد. این جدال، فراتر از اختلافی فنی، به پرسشی بنیادین دربارهٔ حقیقت در عصر هوش مصنوعی بدل شده است؛ دورانی که خطاهای الگوریتمی میتوانند به بحرانِ اعتبار برای غولهای فناوری و بیاعتمادیِ فزاینده در نهادهای سیاسی منجر شوند

در میانهٔ جدالی که از واشنگتن تا سیلیکونولی کشیده شده، گوگل با ارسال نامهای رسمی به سناتور مارشا بلکبرن تلاش کرده شکاف میان سیاست و فناوری را توضیح دهد. موضوع این اختلاف از مدل هوش مصنوعی «جما» آغاز شد؛ مدلی که به گفته بلکبرن، در پاسخهایش اتهامات جنسی جعلی علیه او ساخته و منتشر کرده است.

در نامهای که روز پنجشنبه از سوی کاران بهاتیا، معاون امور دولتی گوگل، به دفتر بلکبرن ارسال شد، این شرکت نوشت که خطاهای موسوم به توهم هوش مصنوعی نه سیاسی بلکه فنیاند. بهاتیا تأکید کرد:

«پدیدهٔ هلوسینیشن در تمام مدلهای زبانی بزرگ وجود دارد و کاربران در سراسر طیف سیاسی با آن مواجه شدهاند. این مسئله به طراحی فنی مدلها برمیگردد، نه به سوگیری یا قصد انسانی.»

او در بخش دیگری افزود که مدلهای کوچکتر و باز مانند جما، بهویژه آنهایی که برای توسعه و آزمایش طراحی شدهاند، «برای واقعنمایی خبری ساخته نشدهاند» و در صورت استفاده عمومی بدون کنترل دقیق، دچار انحراف داده و پاسخ میشوند.

اما بلکبرن با لحنی تند در بیانیهای که به آکسیوس ارسال کرد، گفت:

«پاسخ گوگل چیزی جز فرار از مسئولیت نیست. این شرکت تقصیر را به گردن مسائل فنی انداخته، بیآنکه توضیح بدهد چرا چنین اتهامات هولناکی خلق شدهاند و چگونه قصد دارد از تکرارشان جلوگیری کند.» او در ادامه افزود: «گوگل سالها از وجود هلوسینیشنهای مضر در مدلهایش آگاه بوده اما تنها وقتی برای حفظ چهرهٔ عمومی خود تحت فشار قرار گرفت، تصمیم به توضیح گرفت.»

تحلیلگران رسانه میگویند این رویارویی آغاز فصل تازهای در تقابل میان سیاستمداران محافظهکار و شرکتهای بزرگ فناوری است؛ تقابلی که پیشتر بر محور «سانسور شبکههای اجتماعی» متمرکز بود و اکنون به «اعتماد دادههای هوش مصنوعی» رسیده است. یکی از کارشناسان سیاست فناوری در واشنگتن توضیح میدهد:

«وقتی مدلهای زبانی خطا میدهند، بحث فنی فوراً به نبرد سیاسی تبدیل میشود. از نگاه نمایندگان محافظهکار، هر خطای دادهای میتواند نشانهٔ یک سوگیری باشد؛ در نتیجه دفاع علمی شرکتها دیگر کافی نیست.»

با وجود توضیحات فنی گوگل، بلکبرن همچنان بر مواضع خود پای فشرده و گفته است موضوع «امنیت کودکان» و «پاسخگویی شرکتهای فناوری» را با جدیت بیشتر در جلسات آیندهٔ کنگره پیگیری خواهد کرد.

کارشناسان پیشبینی میکنند جنجال جما تنها نمونهٔ نخست باشد؛ جدالی که مرز میان خطای فنی و انگیزهٔ سیاسی را در دنیای هوش مصنوعی به آزمایش گذاشته است.

در همین باره

پیشنهادها

خوانده شده ها

آخرین خبرها

مطالب مرتبط

تبلیغات